隨著人工智能技術(shù)的飛速發(fā)展,AI的應(yīng)用場景日益豐富,甚至開始滲透進交友軟件領(lǐng)域。然而,在這一波技術(shù)浪潮中,一個名為“Prompt逐步失效”的現(xiàn)象逐漸浮出水面,引起了業(yè)界的廣泛關(guān)注。

在大規(guī)模預(yù)訓(xùn)練模型不斷更新迭代的背景下,生成式AI的應(yīng)用變得越來越廣泛。然而,許多用戶發(fā)現(xiàn),曾經(jīng)那些精準有效的提示詞,如今卻似乎失去了魔力。無論是要求AI生成特定方案,還是進行創(chuàng)意設(shè)計,得到的回答往往變得模糊不清,缺乏條理,甚至充斥著模板化的套話。這種變化并非用戶的錯覺,而是AI正面臨的一個潛在危機。

以GPT-4為例,這款在2023年發(fā)布的AI模型,曾以其精準解析復(fù)雜指令、進行角色扮演和生成專業(yè)文案的能力給人留下深刻印象。然而,僅僅半年之后,那些被視為“魔法咒語”的提示詞就開始逐漸失效。在新媒體行業(yè),一些團隊曾依賴“角色扮演+結(jié)構(gòu)化指令”的方式批量生成創(chuàng)意文案,但最近卻頻繁遭遇AI拒絕提供具體建議的情況。

表面上看,這種失效似乎是AI模型的能力下降了,但實際上,這反映的是AI倫理審查與內(nèi)容審核機制的日益嚴格。由于使用者眾多,許多細致入微的提示詞被誤判為潛在的風(fēng)險指令,從而限制了生成內(nèi)容的多樣性和深度。不過,這種“Prompt逐步失效”的現(xiàn)象,也在一定程度上促使了AI模型的“退化”,使其在不依賴過于嚴謹或復(fù)雜的語言時,能夠更加自然地生成有用和相關(guān)的輸出。

在新媒體行業(yè),這種“退化”反而帶來了效率的提升。曾經(jīng),團隊需要給出詳盡的指令,包括目標(biāo)群體、市場趨勢、情感調(diào)性等具體元素,才能獲得精準的創(chuàng)意輸出。但現(xiàn)在,只需一個簡單的提示,比如“給我一個吸引年輕人注意的環(huán)保主題文案”,AI就能基于其大規(guī)模的訓(xùn)練數(shù)據(jù)和日常的內(nèi)容生成經(jīng)驗,自動理解并生成出符合年輕群體情感的文案,甚至自然地融入時下流行的文化元素和幽默感。

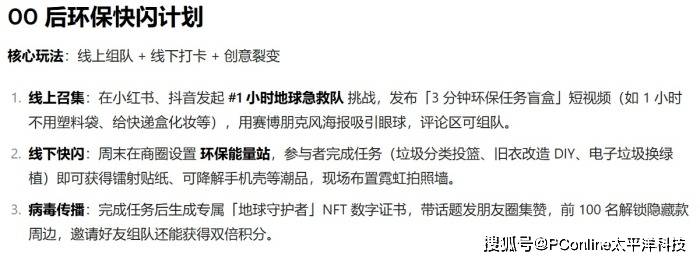

盡管AI技術(shù)取得了顯著的進步,但要實現(xiàn)真正的全自動AI,仍面臨一系列技術(shù)瓶頸。目前的AI模型主要依賴大規(guī)模標(biāo)注數(shù)據(jù)進行語言學(xué)習(xí),使得它們能夠在有限的框架內(nèi)模仿人類語言。然而,當(dāng)面對如“策劃一場吸引00后轉(zhuǎn)發(fā)的環(huán)保活動”這樣的復(fù)雜指令時,AI往往只能給出表面化的回答,缺乏深入的文化洞察與創(chuàng)意。AI的多模態(tài)協(xié)同處理仍存在潛在的誤差和矛盾,比如在生成圖像時可能出現(xiàn)與實際不符的情況。

不過,盡管面臨諸多挑戰(zhàn),AI技術(shù)仍在不斷進步,并已經(jīng)取得了一些突破性進展。例如,一些創(chuàng)新的認知架構(gòu)為全自動AI帶來了新的希望。扣子空間的AI Agent協(xié)同系統(tǒng)不僅帶來了架構(gòu)上的創(chuàng)新,還讓人們看到了全自動AI模型實現(xiàn)的可能性。該系統(tǒng)能夠自動完成需求分析、任務(wù)拆解、工具調(diào)用與結(jié)果生成,極大提升了工作效率與執(zhí)行力。